Les progrès technologiques exponentiels, que l’on observe notamment dans le numérique, ont des répercussions dans tous les domaines de la vie. Ces progrès, qui découlent surtout du secteur commercial, sont à l’origine d'une démocratisation des technologies susceptibles d’être transformées en armes. Les développements technologiques posent aussi de nouveaux dilemmes quant à leur utilisation par le secteur militaire.

En septembre 2017, dans un discours prononcé à Moscou devant un parterre d’étudiants, le président Vladimir Poutine a soutenu – on s’en souvient – que le pays qui deviendrait leader dans la recherche sur l’intelligence artificielle – objectif que la Chine s’est explicitement fixé pour 2030 – « deviendrait le maître du monde ».

Quelques mois plus tard, dans son allocution présidentielle devant la Douma, M. Poutine a annoncé que les essais du nouveau planeur hypersonique russe avaient été menés avec succès et que la production allait pouvoir débuter (cette technologie permet de réduire considérablement le temps nécessaire pour atteindre un objectif, ainsi que d’embarquer des charges conventionnelles ou nucléaires).

En septembre 2019, les rebelles houthis du Yémen ont revendiqué la première attaque massive coordonnée par essaim de drones, menée contre deux installations de production pétrolière d’Arabie saoudite après mise en échec des systèmes saoudiens de défense aérienne.

Par ailleurs, dans la nouvelle crise mondiale, liée à la COVID-19, on constate aussi de plus en plus les effets perturbateurs, voire subversifs, des opérations psychologiques et de (dés)information conduites dans les médias sociaux – sans parler des très nombreuses activités d’espionnage menées par harponnage, voire des cyberattaques directes contre des établissements de soins médicaux.

En somme, au niveau national comme multilatéral, les technologies nouvelles voire de rupture remettent radicalement en question la manière dont les politiques de dissuasion, de défense et, plus largement, de sécurité sont conçues et menées.

Les drones d'un essaim sont capables de prendre des décisions collectives. Cette nouvelle technologie permet aux acteurs étatiques comme non étatiques de causer des dommages et des perturbations, non seulement sur le champ de bataille, mais aussi au niveau des populations civiles et des infrastructures critiques. © Medium.com

Technologie et guerre

De l’âge de pierre à Hiroshima, la technologie a profondément influencé (et parfois contribué à révolutionner) la manière de faire la guerre. La guerre a quant à elle souvent permis de renforcer les technologies qui ont eu par la suite des applications civiles. La manipulation humaine délibérée du monde matériel a presque toujours été à double usage – des outils de chasse aux bateaux, des explosifs aux moteurs à explosion, des chemins de fer aux satellites –, de même que l’ont presque toujours été les chars, les galères, les véhicules motorisés et les aéronefs, entre autres moyens. L’ingénierie scientifique a toujours été au service de la guerre, qu’il s’agisse des fortifications ou de l'artillerie, ou encore de la communication ou de la surveillance. Toutefois, la R&D financée sur fonds publics à des fins militaires n’est devenue systématique qu’à partir de la Seconde Guerre mondiale et a sans doute connu son apogée pendant la Guerre froide.

En temps de guerre, la technologie a toujours été un multiplicateur de forces pour les commandants chevronnés : elle leur permet de faire davantage de mal à l’ennemi ou de limiter les dommages dans leur camp. Tout au long de l’histoire, la supériorité technologique a généralement favorisé la victoire, sans toutefois jamais la garantir : des adversaires de même niveau sont souvent parvenus à égaler et à contrer des avantages tactiques, même dans le cadre d'un conflit commun, tandis que des adversaires d'un niveau manifestement inférieur ont souvent (et parfois avec succès) réagi en adoptant des tactiques « asymétriques ». En d'autres termes, l’avantage technologique dans la guerre dépend toujours des capacités de celui qui se trouve en face.1

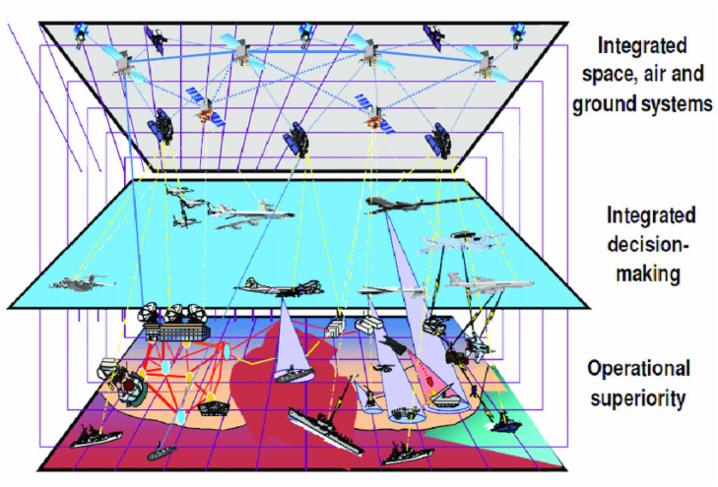

Aujourd'hui, du moins depuis les années 1990, nous observons toutefois que des progrès technologiques exponentiels ont des répercussions dans tous les domaines de la vie – pas uniquement, ni principalement, le domaine militaire. En matière de dissuasion et de défense, le développement et l’application des technologies de l'information et de la communication (TIC), qui ont permis l’émergence des armes à guidage de précision et de la « guerre réseaucentrique », ont initialement été considérés comme une autre « révolution dans les affaires militaires » – les précédentes étant notamment l’apparition du char dans l’Antiquité, l’invention de la poudre à canon à l’aube de l’ère moderne, l’arrivée des unités motorisées après la révolution industrielle et l’émergence des armes nucléaires depuis la Seconde Guerre mondiale. Il est évident à présent que la guerre « réseaucentrique », tout en se développant à un rythme rapide, est probablement plus un processus de transformation évolutif et progressif qu’une véritable révolution. Elle a toutefois encore des incidences largement imprévisibles sur la dissuasion, la défense et, plus généralement, la sécurité.

La guerre réseaucentrique est née des avancées réalisées dans le domaine numérique. La mise en réseau de plateformes individuelles facilite l’échange d'informations, améliore la connaissance de la situation et accélère la prise de décision et les temps de réponse. © Research Gate

Comme ce fut le cas lors des précédentes (r)évolutions, celle en cours devrait modifier profondément le(s) rapport(s) de forces dans le monde – non seulement entre les empires, les villes-États ou les États-nations, comme par le passé, mais aussi parmi et entre les acteurs : de grandes entreprises technologiques, par exemple, commencent à gagner un pouvoir, voire un statut, souvent comparable à celui d’un État. Le XXIe siècle est de fait marqué par une accélération exceptionnelle du développement technologique, essentiellement grâce au secteur commercial, et notamment dans le domaine numérique. Il en résulte un réseau de plus en plus dense de connexions en temps quasi réel dans tous les domaines de l’activité sociale, un réseau qui est sans précédent de par son ampleur et de par sa vitesse. Les nouvelles technologies qui sont facilement disponibles, intelligemment employées et combinées ensemble offrent donc aux acteurs étatiques comme non étatiques toute une série de nouveaux outils capables de causer des dommages et des perturbations au-delà de ce qui était imaginable il y a quelques décennies, non seulement au niveau des forces militaires traditionnellement supérieures sur le champ de bataille, mais aussi au niveau des populations civiles et des infrastructures critiques.

En outre, la plupart de ces technologies – à l’exception, peut-être, des systèmes furtifs et hypersoniques – découlent d’un écosystème fondamentalement différent du traditionnel modèle ou « complexe » industriel de défense, basé sur une planification et un développement capacitaires à long terme selon une approche descendante, sur un approvisionnement oligopolistique (vendeurs peu nombreux en raison d'une concurrence hors prix) et sur une demande monopsone (acheteur unique). Ainsi, par le passé, la R&D militaire a donné naissance à des technologies qui ont ensuite été adaptées et commercialisées pour un usage civil, comme les radars, les moteurs à réaction ou l’énergie nucléaire.2 Les nouvelles technologies sont en revanche développées selon une approche ascendante, et le délai entre leur conception et leur mise sur le marché est extrêmement court : ce n’est qu’après avoir touché des millions de consommateurs du monde entier et avoir créé des effets de réseau qu’elles deviennent à double usage, et peuvent donc être « transformées en armes ».

On constate que ce qui sous-tend l’innovation à double usage a considérablement évolué, les retombées découlant essentiellement du secteur civil. L’investissement dans la science et la technologie (S&T) est à présent principalement déterminé par les marchés commerciaux, au niveau tant national que mondial, et l’importance des dépenses d'investissement S&T est sans commune mesure avec celles spécifiquement consacrées à la défense, si bien que, dans certains domaines technologiques, la défense repose entièrement sur l'évolution de la société civile et des marchés. Les nouvelles superpuissances (et « superinfluenceurs ») sont les géants privés de la grande consommation technologique situés sur la côte ouest des États-Unis et en Chine continentale.

Contrôle à distance et perte de contrôle

Les dernières avancées technologiques favorisent notamment le développement et la démocratisation des armes « tirées à distance de sécurité », c’est-à-dire des engins armés qui peuvent être lancés à une distance suffisante pour permettre aux attaquants d’échapper aux tirs défensifs effectués depuis la zone d'objectifs. La délégation et l’externalisation de fonctions militaires à des auxiliaires, des mercenaires, des sociétés privées, des insurgés ou des contractants – c’est-à-dire la « guerre de substitution », telle que récemment étiquetée – n'ont certes rien de nouveau, mais les nouvelles technologies remettent en question l’équilibre recherché entre délégation et contrôle, et créent de nouveaux dilemmes en rendant possible l’exploitation à distance de plateformes sans pilote, d'abord à des fins de reconnaissance et de surveillance, puis pour des missions de punition et de décapitation. Même si ce n’est pas la première fois qu’une machine est utilisée comme substitut dans une guerre (les missiles de croisière ont servi un objectif similaire), les nouvelles armes offrent aussi un niveau incomparable de discrétion (faible visibilité, y compris sur le plan intérieur) et de possibilité de déni, notamment devant la communauté internationale. 3

Plus important encore, certaines de ces nouvelles armes sont aujourd'hui facilement accessibles sur les marchés commerciaux et relativement simples à utiliser, ce qui brise encore plus le traditionnel monopole de l’armement et de l’utilisation légitime de la force détenu par les États et ouvre de nouveaux « espaces » pour de nouveaux types de guerre. Ces armes ont déjà été utilisées dans des opérations de (contre-)terrorisme et de (contre-)insurrection à l’étranger, mais elles pourraient facilement être déployées dans des environnements urbains – et éventuellement transformées en vecteurs d’agents chimiques, biologiques ou radiologiques. En réalité, l'accès et l’intention sont à chaque fois des aspects essentiels : les barrières à leur utilisation se lèvent, et leur champ d'application s’élargit.

Les armes basées dans le cyberespace – lorsqu’elles sont utilisées à des fins de sabotage (cyberattaques) et de subversion (campagnes de désinformation et de déstabilisation) plutôt qu’à des fins d’espionnage – vont, quant à elles, encore plus loin en termes de coercition et de perturbation, tout en préservant la discrétion et la possibilité de déni, car elles sont employées dans un environnement purement artificiel et mal réglementé qui repose entièrement sur la technologie. Les armes numériques peuvent en fait produire des effets stratégiques comparables à ceux d'une guerre sans recourir à la violence physique directe, même si la plupart des experts considèrent la « cyberguerre », au sens strict, comme un scénario tout à fait fantaisiste. Contrairement aux armes nucléaires, les armes numériques ne sont pas conçues pour la dissuasion mais pour une utilisation réelle voire permanente, et elles peuvent être employées par des États ainsi que par des supplétifs et des organismes privés sans contraintes géographiques ni juridictionnelles : ceux qui s’en servent sont difficiles à identifier, et les représailles sont risquées.4

L’espace médiatique est devenu un nouveau champ de bataille, constituant désormais une sphère publique mondiale transnationale, où les idées que l'on se fait du bien et du mal, de la victoire et de la défaite (les « effets d'audience »)5 se construisent et se renforcent à une vitesse fulgurante. Les médias sociaux n’ont peut-être pas été militarisés – même si les militaires les utilisent eux aussi, ce qui les rend vulnérables aux campagnes hostiles – mais ils ont certainement été transformés en armes. Dans ce nouveau jeu, que l'on appelle la « guerre des sources ouvertes » 6, les citoyens et les consommateurs jouent souvent le rôle d’auxiliaires plus ou moins involontaires. De fait, alors que le cybersabotage nécessite un niveau élevé de savoir-faire mais relativement peu de main d’œuvre, la cybersubversion est beaucoup plus simple à concevoir mais nécessite de très nombreux utilisateurs pour la diffusion des messages. L’utilisation combinée de toutes ces technologies dans une stratégie globale ayant des variantes tactiques a été conceptualisée sous le terme de guerre « hybride » – ou, simplement, d’ « activité malveillante » lorsque le niveau du conflit armé n’est pas atteint.7

Enfin, l’espace proprement dit est resté, du moins jusqu’à présent, relativement à l’abri de ces évolutions, grâce aux dispositions du traité sur l’espace extra-atmosphérique (1967) et compte tenu des risques intrinsèquement liés au possible recours à la force (p. ex. débris). Les développements technologiques concernant l’espace visent avant tout à faciliter l’activité sur terre – principalement au moyen des communications par satellite pour la radiodiffusion/télédiffusion et pour la navigation – des acteurs publics mais aussi maintenant, de plus en plus, des acteurs privés, avec tous les effets de démocratisation que cela entraîne. Les États les plus compétents ont d'ailleurs partiellement militarisé l’espace, et de plus en plus d’États (grâce aussi à l’évolution technologique) sont à présent capables d’entrer dans le jeu. Alors qu’il n’existe pas de protocoles ou de règles d'engagement éprouvés pour l'activité militaire dans l’espace, la militarisation des moyens basés dans l’espace semble néanmoins toujours un scénario improbable. 8

Les machines intelligentes et les perspectives qu’elles offrent

Abordons maintenant l’intelligence artificielle, l’apprentissage automatique et l’autonomie (l’informatique quantique pourrait avoir un horizon plus lointain, sans pour autant se révéler non moins perturbatrice). Le concept d’intelligence artificielle remonte au début des années 1950, mais cette technologie n’a progressé que très lentement jusqu’à la dernière décennie. Trois grands changements se sont alors produits : la miniaturisation des processeurs a accru la puissance de calcul, la généralisation des appareils mobiles et connectés a favorisé la production d’une énorme quantité de données et, enfin, l’application de nouveaux types d’algorithmes exploitant les avancées réalisées dans l’apprentissage automatique (et en particulier les réseaux neuronaux) a accru les capacités globales des machines. 9

Le véhicule aérien de combat sans pilote X-47B, développé par Northrop Grumman en coopération avec la DARPA (Agence pour les projets de recherche avancée de défense) des États-Unis, est semi-autonome. (Photo aimablement communiquée par Northrop Grumman)

Dans le domaine de la santé publique et du diagnostic, comme la recherche sur le cancer, ces développements technologiques se révèlent déjà utiles, et leurs avantages incontestables. En revanche, dans le domaine de la sécurité et de la défense, la question n’est pas encore tranchée : la perspective de systèmes d'armes totalement autonomes suscite notamment un certain nombre de préoccupations d’ordre éthique, juridique et opérationnel (https://www.nato.int/docu/review/articles/2017/07/28/autonomous-military-drones-no-longer-science-fiction/index.html).

L’ « autonomie » des systèmes d'armes est un concept controversé au niveau international, ses niveaux d’acceptabilité faisant l’objet de diverses interprétations. Les débats à ce sujet ont notamment amené l’ONU a créé, en 2016, un groupe d’experts gouvernementaux sur les systèmes d'armes létaux autonomes (SALA). Celui-ci n’est toutefois pas encore parvenu à des conclusions concertées, ce qui s’explique en partie par le paysage stratégique actuel et par des raisons « géopolitiques » : certains États développant ces systèmes n'ont aucun intérêt à ce qu’une réglementation soit mise en place, estimant pouvoir encore prendre un certain avantage sur les autres. Cela s’explique aussi par le fait que l’ « autonomie » est un concept tout relatif.

Quelques analystes contesteraient que, dans un environnement tactique compromis, un certain niveau d'autonomie est essentiel pour qu’une plateforme sans pilote reste un outil opérationnel efficace. Des systèmes d’armes automatiques existent d'ailleurs depuis longtemps (p. ex. mines terrestres) et des systèmes automatisés sont déjà utilisés pour la protection des civils et des forces, comme le système israélien de défense antimissile « Iron Dome » ou encore les systèmes d'artillerie faisant appel à des capteurs sur les navires de guerre. À quelques exceptions près, les systèmes d'armes d'aujourd'hui sont au mieux semi-autonomes. Ils sont aussi généralement très coûteux et donc difficiles à sacrifier.

Des facteurs technologiques et opérationnels limitent encore l’utilisation possible des SALA : alors qu’il est de plus en plus facile de prendre à partie des objectifs, le risque d’erreur d'appréciation, les effets d’escalade et le manque d'imputabilité – éléments qui sont tous susceptibles de remettre en question les normes internationales établies et le droit des conflits armés – semblent souligner la nécessité d’un véritable contrôle humain. Il subsiste toutefois la tentation d’exploiter l’avantage technologique temporaire que procure une première frappe, sans compter que tous les acteurs concernés pourraient ne pas respecter les mêmes règles éthiques et juridiques.

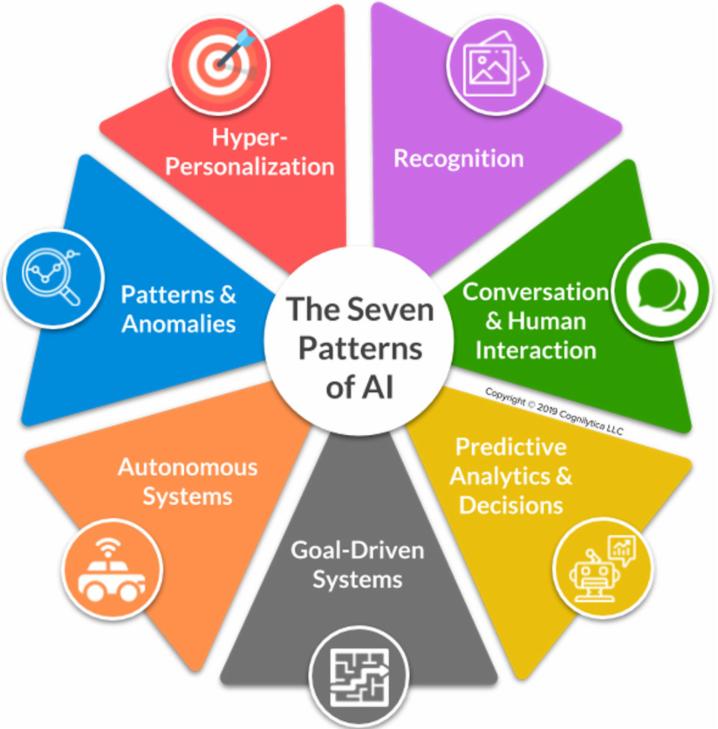

Par ailleurs, au-delà du traditionnel domaine militaire, les récents progrès spectaculaires accomplis en matière de reconnaissance vocale et faciale (technologie qui repose fortement sur l’intelligence artificielle) pourraient encourager plus encore la subversion, alors que la conception de logiciels malveillants adaptatifs toujours plus sophistiqués pourrait favoriser davantage le sabotage. Les États qui pourront établir l’infrastructure et les normes sous-tendant de telles activités obtiendront un avantage stratégique. Toutefois, comme c’est déjà le cas dans le domaine de la recherche médicale, l’intelligence artificielle peut aussi servir pour la détection, la reconnaissance des formes et les processus de simulation – autant d’aspects potentiellement cruciaux dans les domaines de la lutte contre le terrorisme, de la protection civile et de la réaction aux catastrophes ainsi que dans le domaine de la maîtrise des armements (contrôle et vérification). Les applications sur mesure qui reposent sur l’intelligence artificielle peuvent de fait améliorer le renseignement, la connaissance de la situation, l’analyse et, peut-être, la prise de décision. L’intelligence artificielle peut aussi servir pour des applications pratiques déjà courantes dans le secteur commercial (p. ex. logistique plus efficace ou maintenance prévisionnelle des équipements), qui jouent toutes un rôle très important dans le secteur militaire.

En outre, la plupart des experts soulignent qu'il existe deux types d’intelligence artificielle : (1) l’intelligence artificielle faible se réfère aux systèmes à fonction unique, c’est-à-dire aux machines pouvant accomplir des tâches uniques extrêmement bien dans un domaine particulier mais se révélant presque inutiles dans des scénarios inhabituels ou pour d'autres applications ; (2) l'intelligence artificielle forte se réfère à la capacité d’une machine de conduire de multiples activités multidimensionnelles sans avoir été explicitement programmée ni entraînée à cette fin – une capacité dont l’horizon semble encore lointain.

Pour l’avenir prévisible, la gamme des applications militaires potentielles de l’intelligence artificielle faible semble assez intéressante. Les investissements dépendront toutefois de la propension à prendre des risques financiers avec des budgets publics limités et seront probablement mis en balance avec d’autres priorités opérationnelles et de modernisation. Là aussi la technologie peut être une bénédiction comme une malédiction, et il n’est pas exclu que le schéma observé jusque-là, à savoir que les technologies de remplacement de la main-d'œuvre se heurtent à davantage d'opposition que les technologies de base, se reproduise.10

Par le passé, les efforts déployés au niveau international pour contrôler la prolifération, la production, le développement ou le déploiement de certaines technologies militaires (agents chimiques, biologiques, radiologiques et nucléaires, mines terrestres, lasers aveuglants ou encore systèmes de défense antimissile) avaient tous, à des degrés divers, des fondements logiques distincts pouvant toutefois se recouper : l’éthique, la légalité, la stabilité et la sûreté. La possibilité d’utiliser l’intelligence artificielle à des fins militaires a suscité des préoccupations sur ces quatre plans. Par le passé, encore, des courses aux armements apparemment inévitables dans ces nouveaux domaines ont été ralenties voire stoppées grâce à une certaine institutionnalisation des normes – généralement menée à bien après que les technologies en question eurent atteint un certain niveau de maturité, et souvent préconisée, inspirée voire concrétisée par des communautés d’experts compétents (du secteur public et/ou du monde universitaire).

En tant que technologie à usage général, l’intelligence artificielle est toutefois assez particulière, tout comme le sont les communautés d’experts associées à son développement et à ses applications.11 Il est néanmoins encourageant de noter que de nombreux pays (p. ex. dans le cadre de l’Organisation de coopération et de développement économiques) et de nombreuses entreprises (p. ex. IBM, Microsoft et Google) se sont récemment exprimés en faveur d’un code de conduite commun pour l’intelligence artificielle – voire ont énoncé publiquement leurs propres principes, comme l’a par exemple fait le Pentagone –, notamment en ce qui concerne les incidences militaires et éthiques de cette technologie.

En d'autres termes, il est indéniable que le risque d'une course aux armements dans le domaine de ces technologies émergentes existe, et que les éventuelles conséquences imprévues d'une utilisation inconsidérée de l’intelligence artificielle suscitent des préoccupations plus générales – exprimées par des personnes comme Henry Kissinger, Stephen Hawking et Elon Musk. Mais l’espoir demeure que ces technologies puissent encore être orientées vers des applications moins perturbatrices et se retrouver dans la même catégorie que les gaz toxiques ou les armes antisatellites – où les États les plus puissants s’abstiennent de s'attaquer les uns les autres, du moins militairement, tandis que les États plus faibles ou les acteurs non étatiques peuvent encore mener des attaques, mais sans grand résultat.